< Terug naar nieuws

6 December 2023

Hoe maak je pratende machines menselijker (maar zonder de slechte kanten)?

Dit jaar braken AI-systemen die menselijke teksten schrijven wereldwijd door. Toch zijn veel wetenschappelijke vragen over hoe ze precies werken nog onbeantwoord. Drie UvA-onderzoekers proberen de onderliggende taalmodellen transparanter, betrouwbaarder en menselijker te maken.

De lancering van ChatGPT door OpenAI op 30 november 2022 betekende een game-changer voor kunstmatige intelligentie (AI). Ineens maakte het grote publiek kennis met de kracht van schrijvende machines. Een kleine twee maanden later had ChatGPT al honderd miljoen gebruikers.

Inmiddels gebruiken studenten het om essays te schrijven, programmeurs om code te genereren en bedrijven voor het automatiseren van allerhande schrijftaken. Tegelijkertijd zijn er grote zorgen over de onbetrouwbaarheid van automatisch gegenereerde teksten en over het napraten van stereotypen en discriminatie die in de trainingsdata zitten.

Wereldwijd sprongen media snel bovenop ChatGPT met verhalen die heen en weer slingerden tussen jubel en onheil. 'Vóór de lancering van ChatGPT vond ik het in de media lange tijd oorverdovend stil', zegt UvA-onderzoeker Jelle Zuidema, 'terwijl mijn collega's en ik de afgelopen jaren meerdere malen aan de bel hebben getrokken om te vertellen dat er een belangrijke ontwikkeling aan zat te komen.'

Zuidema is universitair hoofddocent Natural Language Processing, Explainable AI and Cognitive Modelling aan het Institute for Logic, Language and Computation (ILLC). Hij pleit voor een nuchtere discussie over het gebruik van grote taalmodellen, het soort model dat de basis vormt van ChatGPT (zie Kader 1). Zuidema: 'We hebben er niets aan om deze ontwikkeling ofwel te bagatelliseren ofwel er moreel zeer verontwaardigd over te doen, zo van: het is alleen maar plagiaat. Studenten gebruiken het, wetenschappers gebruiken het, programmeurs gebruiken het, en veel andere groepen in de maatschappij gaan ermee te maken krijgen. Dan moeten we het hebben over vragen als: Welke consequenties gaan taalmodellen hebben? Welke banen gaan veranderen? Wat gebeurt er met de eigenwaarde van tekstschrijvers?'

Lees hier meer.

Dit artikel is gepubliceerd door de UvA.

De afbeelding is gegenereerd door de Universiteit van Amsterdam met behulp van Adobe Firefly (keywords: shallow brain architecture).

De afbeelding is gegenereerd door de Universiteit van Amsterdam met behulp van Adobe Firefly (keywords: shallow brain architecture).

Vergelijkbaar >

Vergelijkbare nieuwsitems

29 mei

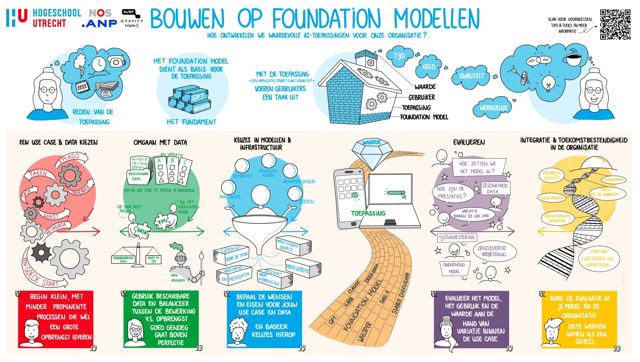

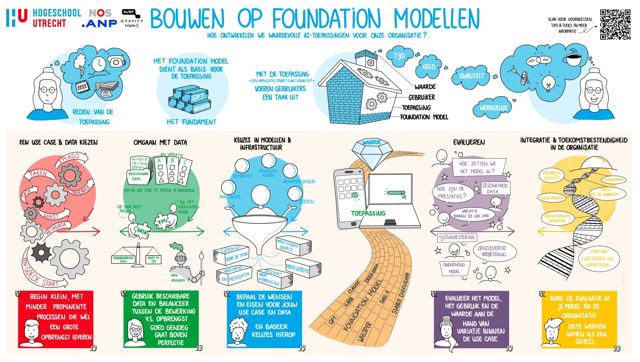

Verantwoord bouwen op foundation modellen: praktische handreiking van Hogeschool Utrecht en RAAIT

Onderzoekers van RAAIT hebben een praktische gids gepubliceerd voor organisaties die AI willen inzetten op basis van foundation modellen. De handreiking helpt gebruikers de juiste keuzes te maken.

Lees meer >

29 mei

SER: Zet mens centraal bij invoering van AI op de werkvloer

De Sociaal-Economische Raad (SER) waarschuwt in een nieuw advies voor de risico’s van AI op werk en roept op tot mensgerichte implementatie en beleid.

Lees meer >

27 mei

🌞 Open Space: AI meets Science Communication – durf jij het podium op?

Werk jij aan AI met maatschappelijke impact? En vraag je je af hoe je daar met de buitenwereld over in gesprek kunt gaan? Kom dan op donderdag 4 juli naar een inspirerende Open Space middag over AI & wetenschapscommunicatie, georganiseerd door Amsterdam AI en NEWS (Nationaal Expertisecentrum Wetenschap & Samenleving).

Lees meer >